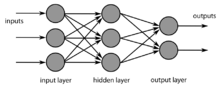

深層学習は、機械学習の一種であり、主にある種のニューラルネットワークで使用される。他の機械学習と同様に、学習セッションは教師なし、半教師付き、教師付きのいずれかである。多くの場合、入力層と出力層の間に少なくとも1つの中間層(または隠れ層)があるように構造が構成されている。

音声、画像、手書き文字などを認識・理解することは、人間にとっては簡単なことです。しかし、コンピュータにとっては非常に困難な作業です。2層以上の多層ニューラルネットワークでは、層を重ねるごとに処理される情報が抽象化されていきます。

深層学習モデルは、生物の神経系における情報処理やコミュニケーションのパターンからヒントを得ていますが、生物の脳(特に人間の脳)の構造的・機能的特性とは異なる点が多く、神経科学のエビデンスとは相容れないものです。

深層学習の基本的な仕組み

深層学習は多数のパラメータ(重みとバイアス)を持つ多層のニューラルネットワークを用いて、入力データから複雑な特徴や関係性を自動的に学習します。主な要素は次の通りです。

- 層(Layer):入力層、複数の隠れ層、出力層で構成されます。隠れ層が深いほど「深層」になります。

- 活性化関数:各層の出力に非線形性を与えます。代表的なものはReLU、シグモイド、tanhなどです。

- 損失関数:モデルの出力と正解との誤差を定量化します。分類ならクロスエントロピー、回帰なら平均二乗誤差がよく使われます。

- 最適化手法:誤差を減らすためにパラメータを更新します。確立的なものに確率的勾配降下法(SGD)、Adamなどがあります。

- 誤差逆伝播法(バックプロパゲーション):損失から各パラメータの勾配を効率的に計算し、それを使って重みを更新します。

代表的なアーキテクチャ

- 畳み込みニューラルネットワーク(CNN):画像認識や物体検出で広く使われます。局所的な特徴を捉える畳み込みフィルタとプーリングで構成されます。

- 再帰型ニューラルネットワーク(RNN)/LSTM/GRU:時系列データや自然言語処理で用いられます。系列の文脈を保持する設計が特徴です。

- トランスフォーマー(Transformer):自己注意機構(Self-Attention)を用い、多くのNLPタスクでRNNを置き換え、現在は画像や音声などの分野でも応用されています。

- オートエンコーダ(Autoencoder):データ圧縮や特徴抽出、異常検知に使われます。入力を低次元表現に圧縮して再構成します。

- 敵対的生成ネットワーク(GAN):生成モデルの一つで、画像生成やデータ合成に強力な性能を発揮します。生成器と識別器が競合します。

主な応用分野

- コンピュータビジョン:画像分類、物体検出、セグメンテーション、顔認識など。

- 音声と音声認識:音声認識、音声合成(TTS)、感情認識など。

- 自然言語処理(NLP):機械翻訳、要約、質問応答、対話システム、言語モデル(GPTなど)。

- 医療・ヘルスケア:画像診断支援、疾患予測、ゲノム解析。

- 自動運転・ロボット:センサー融合、経路計画、物体検出と追跡。

- 推薦システム:パーソナライズ、行動予測、広告配信。

- 芸術・創作:画像・音楽生成、スタイル転送。

実践上のポイント

- データの質と量:深層学習は大量のデータを必要とすることが多いです。データの前処理、ラベリング、増強(データ拡張)は非常に重要です。

- 過学習対策:正則化、Dropout、早期停止、データ拡張、交差検証などを活用します。

- 計算資源:GPUやTPUなどのハードウェアが学習時間に大きく影響します。クラウドサービスや分散学習も一般的です。

- 転移学習:事前学習済みモデルを微調整(ファインチューニング)することで、データが少ないタスクでも高精度を出しやすくなります。

- フレームワーク:代表的なライブラリにTensorFlow、PyTorch、Kerasなどがあります。実装や実験のしやすさで選ばれます。

評価と運用

精度や損失だけでなく、適切な評価指標(精度、再現率、F1スコア、ROC-AUCなど)や、デプロイ後の推論速度、メモリ使用量、信頼性も考慮する必要があります。実運用ではモデル監視、再学習パイプライン、データドリフトの検出が重要です。

課題と注意点

- 解釈性の低さ:多くの深層学習モデルはブラックボックス的で、なぜその出力になったか説明が難しい場合があります。

- バイアスと倫理:学習データに含まれる偏りがモデルに反映され、不公正な判断を招く可能性があります。倫理的配慮と公平性の評価が不可欠です。

- 計算と環境コスト:大規模モデルの学習には大量の電力が必要で、環境負荷やコストが問題になります。

- 現実世界でのロバストネス:ノイズや分布の変化、敵対的攻撃に対する耐性を高める設計が求められます。

これから深層学習を学ぶ人へのアドバイス

- まずは基礎(線形代数、確率・統計、微分、基本的な機械学習概念)を押さえましょう。

- 小さなプロジェクトで実装と実験を繰り返すこと。公開されているデータセットやチュートリアル(MNIST、CIFAR、ImageNetなど)を使うと良いです。

- 事前学習済みモデルを活用して転移学習を試し、モデルの挙動を観察してください。

- 最新の論文(arXivなど)やコミュニティ(GitHub、フォーラム、学会)で動向を追うことも役立ちます。

多層構造のニューラルネットワーク。

以上は入門的な要点のまとめです。用途や目的によって取り組み方や重要な技術は変わるため、実際の問題に合わせてアーキテクチャや手法を選び、評価と改善を繰り返すことが成功の鍵です。