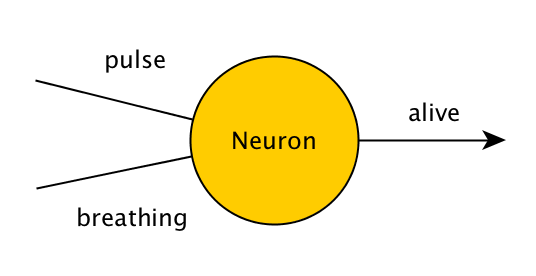

ニューラルネットワーク(ANN、Artificial Neural Networkとも呼ばれる)は、生物の神経細胞から着想を得た一種のコンピュータ・ソフトウェアである。生物の脳は難しい問題を解決する能力がありますが、それぞれのニューロンは問題のごく一部しか解決することができません。同様に、ニューラルネットワークは、個々の細胞は問題のごく一部を解決することにしか責任を負わないが、望ましい結果を生み出すために協力し合う細胞で構成されている。これは、人工的に知的なプログラムを作るための一つの方法である。

ニューラルネットワークは、機械学習の一種で、学習によってプログラムが変化し、問題を解決していくものである。しかし、ニューラルネットワークの規模が大きくなればなるほど、より多くの例題が必要となり、ディープラーニングの場合、数百万から数十億の例題が必要になる。

基本的な仕組み(構成要素)

ニューラルネットワークは多数の人工ニューロン(ノード)を層状に並べたもので、以下の要素で構成されます。

- 入力層:外部データ(画像のピクセル値や数値など)を受け取る層。

- 隠れ層(複数あることが多い):入力を処理して特徴を抽出する層。層が深くなるほど複雑な特徴を学習できる。

- 出力層:問題の答え(分類ラベルや予測値など)を出力する層。

- 重み(weights)とバイアス(bias):ノード間の接続の強さを表すパラメータで、学習によって更新される。

- 活性化関数(activation function):ノードが受け取った総入力を変換し、非線形性を導入する関数(例:ReLU、シグモイド、tanh)。

学習の流れ(訓練)

一般的な学習プロセスは次のようになります。

- 1) 順伝播(forward pass):入力データがネットワークを通り、出力が計算される。

- 2) 損失関数(loss)で出力と正解との差を評価する。例:平均二乗誤差、交差エントロピー。

- 3) 逆伝播(backpropagation):損失を各パラメータに関して微分し、勾配を計算する。

- 4) 最適化(optimizer):勾配に基づいて重みを更新する(例:確率的勾配降下法(SGD)、Adamなど)。

- 5) この過程を複数エポック(全データを何度も繰り返す)で行い、性能を改善する。

学習時にはデータを訓練用・検証用・テスト用に分け、過学習(オーバーフィッティング)を防ぐために正則化や早期停止、ドロップアウトなどの手法が使われます。

代表的なアーキテクチャ

- フィードフォワードNN(全結合ネットワーク):最も基本的な構造。層ごとに全結合する。

- 畳み込みニューラルネットワーク(CNN):画像や映像の処理に強く、局所的な特徴を捉える畳み込み層を持つ。

- リカレントニューラルネットワーク(RNN)・LSTM・GRU:時系列データや文章など、順序情報を扱う。

- トランスフォーマー(Transformer):自己注意機構(self-attention)により並列処理が可能で、自然言語処理で高い性能を示す。

- 生成モデル(例:GAN、VAE):画像生成やデータ拡張に使われる。

主な応用例

- 画像認識・物体検出(医療画像の診断支援、顔認証など)

- 音声認識・音声合成(音声アシスタント、音声検索)

- 自然言語処理(機械翻訳、要約、感情分析、チャットボット)

- 時系列予測(株価予測、需要予測、異常検知)

- 強化学習との組み合わせ(ゲームAI、ロボット制御、自動運転の一部)

長所・短所と実運用での注意点

- 長所:複雑な非線形問題を自動で表現でき、高次元データから有用な特徴を抽出できる点。

- 短所:大量のデータと計算資源(GPU/TPUなど)が必要であり、学習過程がブラックボックスになりやすく可解釈性が低い。

- データの質と量:ラベルの誤りや偏りがあると性能に悪影響が出る。ディープモデルでは数百万~数十億サンプルが要求されることがある。

- 過学習への対策:正則化、ドロップアウト、データ拡張、クロスバリデーション、早期停止などを組み合わせる。

- 計算コスト:訓練には大量の計算時間がかかるため、ハードウェアや効率的な実装、学習率スケジューリングが重要。

- 倫理・安全性:バイアスやプライバシー、誤用に注意。モデルの挙動を評価・監査する運用が必要。

まとめ(実務的な視点)

ニューラルネットワークは強力なツールであり、適切なデータと設計、計算資源を用いれば多くの実世界問題を解決できます。一方で、データ準備、ハイパーパラメータ調整、モデルの評価・解釈、運用体制の整備など実務上の作業も多く存在します。最初は小さなモデルと適切な検証プロセスで始め、必要に応じてモデルを拡張したり、事前学習済みモデルの転移学習を活用するのが現実的な進め方です。